Una mirada crítica sobre la inteligencia artificial

Lo que llamamos máquinas inteligentes son procedimientos tecnológicos que van más allá de la programación que sus diseñadores querían implementar. ¿Cómo hacemos para que estén bajo el control humano y asumir, a la vez, que estas tecnologías, por su naturaleza, están diseñadas para evolucionar fuera de nuestro control? ¿Qué tipo de control es compatible con las exigencias de humanización y con la propia filosofía de estas tecnologías?

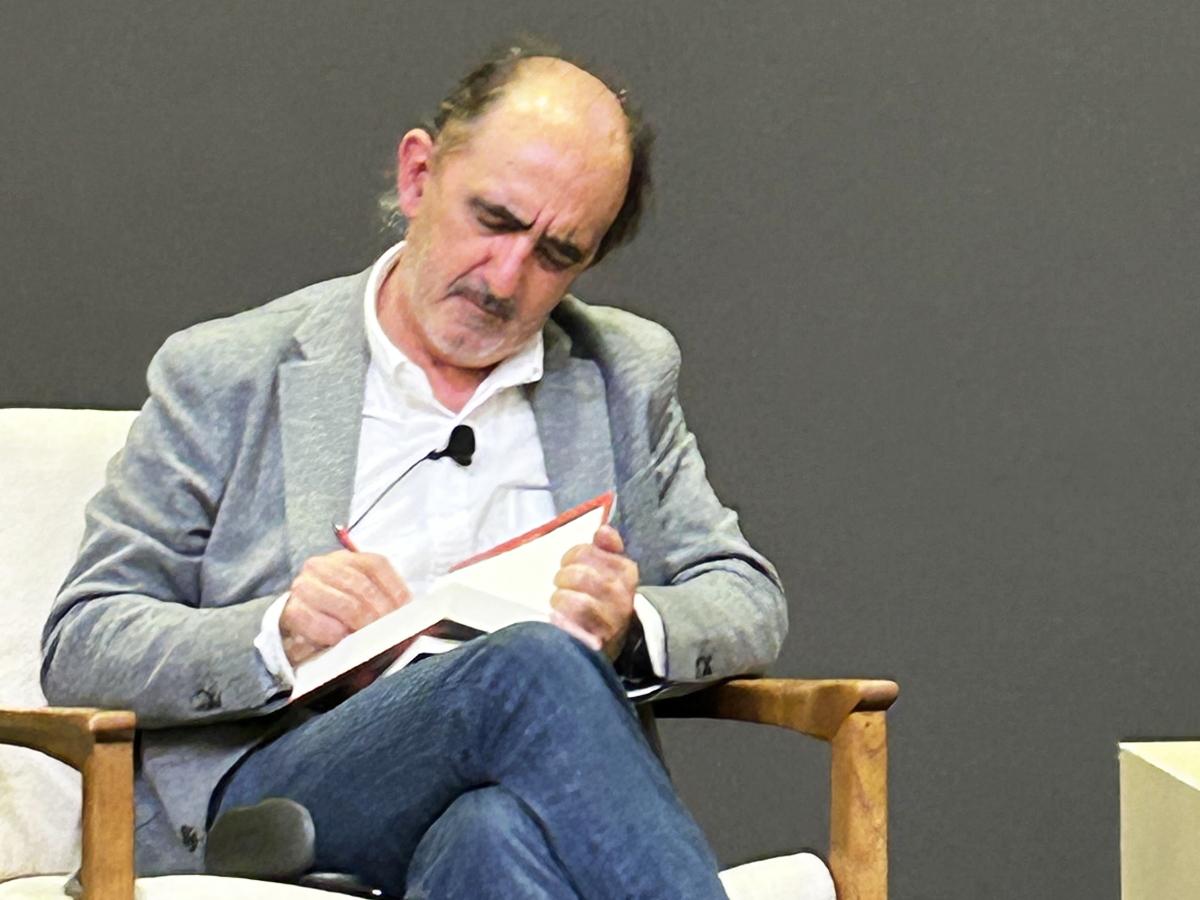

El pasado 1 de marzo se presentaba en la Fundación Ramón Areces el libro de Daniel Innerarity Una teoría crítica de la inteligencia artificial (Galaxia Gutenberg, 2025). El autor, doctor en filosofía y director de la cátedra sobre Inteligencia artificial y democracia en la Universidad de Florencia y antiguo colaborador de la Fundación SM, estuvo acompañado por Senén Barro, experto en inteligencia artificial de la universidad de Santiago de Compostela y por María González Veracruz, secretaria de Estado de digitalización, reexaminaba el concepto de democracia en la actual encrucijada tecnológica y hacía propuestas para el control político de la tecnología, con el fin de lograr su integración equilibrada y justa en un mundo negociable. Presentamos un resumen de las principales ideas desplegadas por Innerarity.

¿Por qué una teoría crítica?

La irrupción de la inteligencia artificial nos obliga a repensar numerosos asuntos. Decía Innerarity que ante el conjunto de problemas planteados por el creciente protagonismo de la inteligencia artificial en todos los ámbitos de la sociedad, hay tres respuestas posibles, la moratoria, la ética y la crítica política. Es decir, que la tecnología sea detenida al menos por un tiempo, someterla a códigos éticos o examinarla de acuerdo con una perspectiva de crítica política.

- La idea de moratoria evidencia una falta de comprensión acerca de la naturaleza de la tecnología y de su articulación con los humanos. Nos encontramos con un desfase cada vez más inquietante entre la rapidez de la tecnología y la lentitud de su regulación. Los debates políticos o la legislación son sobre todo reactivos. Una moratoria tendría la ventaja de que el marco regulatorio podría adoptarse de forma proactiva antes de que la investigación siga avanzando, pero las cosas no funcionan así, menos aún con este tipo de tecnologías tan sofisticadas, que probablemente se seguirían desarrollando bajo la supuesta moratoria.

- Otro recurso para tratar de condicionar el desarrollo tecnológico es la apelación a los criterios éticos. En este caso no se trataría de frenar el desarrollo, sino de orientarlo en un determinado sentido. Así lo han pretendido la multitud de instituciones que han elaborado códigos éticos con orientaciones y líneas rojas para los desarrolladores de inteligencia artificial. Pero si la moratoria frenaba demasiado, podríamos decir que la ética frena demasiado poco y puede terminar convirtiéndose en un inofensivo acompañamiento del desarrollo tecnológico irreflexivo.

- La teoría crítica es algo muy distinto de la ética de la inteligencia artificial; comienza precisamente allí donde terminan los llamamientos a desarrollar una inteligencia artificial responsable y humanista. La crítica no es una exhortación a hacerlo bien, sino una indagación de las condiciones estructurales que posibilitan o impiden hacerlo bien.

En resumen, decía Innerarity, la ideología de la razón algorítmica no es tanto ocultación deliberada como irreflexividad. Por ello se hace necesaria una teoría de la decisión democrática en un entorno mediado por la inteligencia artificial, o como proponía en en un artículo de hace unos años, inventar procedimientos e instituciones que funcionen en la nueva constelación digital, al igual que lo hicieron nuestros antepasados en otros momentos de la historia.

¿Está en retroceso el pensamiento democrático? Un experimento mental

Recordaba Innerarity que los humanos siempre hemos aspirado a que algún procedimiento mecánico nos haga menos dependientes de la voluntad de los otros. La racionalidad algorítmica parece prometerlo, pero, se preguntaba: ¿es realmente así? ¿Quién decide cuando aparentemente nadie decide?

Para profundizar en esta cuestión, Innerarity propuso un experimento mental sobre la articulación entre la inteligencia artificial y la democracia. Pidió imaginar que la secretaria de Estado de digitalización, allí presente, hubiera anunciado la puesta en marcha de una máquina capaz de identificar las preferencias e intereses de todas las personas a partir de los numerosos rastros que dejan en nuestra vida digital. Además, esa máquina va a estar permanentemente puesta al día, por lo que en todo momento lo sabría casi todo de todos nosotros y, por si fuera poco, la máquina agregaría todos los datos para obtener un final óptimo.

Si delegáramos las decisiones en una máquina así, que puede tomar decisiones basadas en datos reales y exhaustivos, podríamos pensar que sería más precisa en sus decisiones, hasta el punto de que no harían falta ministerios ni parlamentos. Se trataría de una democracia de los datos, en la que estaríamos “votando” todos los días.

Esta idea tan surrealista ya ha sido propuesta, en realidad, en algunos contextos tecnófilos, pero Innerarity insistió en que se trataba de una pésima idea. Era una mala idea, decía, porque las huellas que dejamos en el espacio digital las hacemos como consumidores, como el yo fáctico de cada uno, pero no reflejan bien nuestro yo aspiracional. Hay muchísima distancia entre lo que declaro ser y lo que aspiro a ser, y también en cómo quiero ser gobernado. Es, además, una mala idea por el concepto de agregación algorítmica de datos, que tiene poco que ver con la forma de aplicar las políticas en una democracia, en la que se trata de generar un espacio de discusión para ponderar la compatibilidad de la solución e imaginarnos su resultado.

Sin embargo, no opinan lo mismo quienes defienden soluciones tecnocráticas, que suponen delegar en los expertos la identificación de los problemas, el diseño de las soluciones y el proceso de toma de decisiones políticas, aunque las evidencias demuestran que estas soluciones tienden a generar una reacción contraria en la opinión pública y pueden contribuir al debilitamiento de nuestras democracias. Tampoco representan los planteamientos de los llamados tecnosolucionistas, para quienes la democracia no puede resolver los grandes problemas, que requieren eficacia, rendimiento y pragmatismo. Y, lamentablemente, estas tesis tecnocráticas y tecnosolucionistas son peligrosamente cercanas a una idea de creciente arraigo entre algunos jóvenes que consideran que la democracia es poco efectiva en la resolución de problemas complejos. En este sentido, el profesor de ciencia política de la Universitat de Barcelona Jordi Muñoz, alertaba en un artículo reciente de la creciente desconfianza de algunos jóvenes hacia la democracia.

No es casualidad, sostiene Muñoz, que estos planteamientos antidemocráticos y populistas resurjan con fuerza en momentos de crisis, en los que las democracias se enfrentan a serias dificultades para adoptar acuerdos comunes que aseguren un bienestar social y económico básico. Según la última encuesta del Centro de Investigaciones Sociológicas (CIS), el 12 % de los jóvenes españoles de entre 18 y 24 años creía que en algunas circunstancias un gobierno autoritario era preferible a un sistema democrático. Y también muestra la misma tendencia el Sondeig d’Opinió 2024 del Institut de Ciències Polítiques i Socials (ICPS) de Catalunya, que destacaba que hasta un 16 % de los hombres jóvenes compartía esta opinión. El tecnosolucionismo derivado de ciertos enfoques de la inteligencia artificial puede ser un factor de riesgo que ayude a consolidar estas tendencias.

Para Innerarity, el mejor camino para la toma de decisiones no está en aplicar soluciones tecnocráticas ni el el tecnosolucionismo que las delega en los algoritmos de la inteligencia artificial. El método democrático de tomar decisiones y resolver problemas es más inteligente que cualquier otro, e insustituible para afrontar problemas ‘salvajes’, esto es, problemas mal definidos en un contexto de incertidumbre.

El método democrático de tomar decisiones es más inteligente que cualquier otro, e insustituible en un contexto de incertidumbre

¿Cómo articular las decisiones entre máquinas y humanos?

Uno de los problemas emergentes, consecuencia del acelerado cambio tecnológico, deriva de que cada vez más decisiones, cotidianas o políticas, se automatizan y se delegan en sofisticados programas tecnológicos, y los algoritmos de IA afectan a un valor fundamental de las sociedades democráticas: la capacidad de decidir. Básicamente la democracia es una conversación y una toma de decisiones como resultado de nuestro libre autogobierno, y la inteligencia artificial amenaza o quiebra estos dos aspectos.

Precisamente, sostenía Innerarity, el problema fundamental de la inteligencia artificial es la creciente externalización de decisiones humanas en ella, a pesar de que todavía no hemos encontrado el equilibro adecuado entre control humano y beneficios de la automatización. Y añadía que el modo en que configuremos la gobernanza de estas tecnologías puede fortalecer o destruir la democracia.

Para decidir qué facetas de nuestras vidas pueden estar regidas por procedimientos algorítmicos, es necesario saber que los humanos y las máquinas somos muy diferentes en lo que llamamos inteligencia. En las máquinas la inteligencia sirve para problemas en los que hay muchos datos y poca ambigüedad. Por el contrario, los humanos tomamos decisiones en contextos con pocos datos y mucha ambigüedad.

Por tanto, el criterio para el reparto entre humanos y máquinas es analizar la naturaleza de los problemas. Si el problema está bien estructurado y no hay ambigüedad, las máquinas lo harán probablemente mejor y más rápido.

Pero una buena parte de los problemas son complejos, y nunca tendremos datos suficientes. Las decisiones con pocos datos y mucha imprevisibilidad son cuestiones difícilmente automatizables. Por tanto, si se trata de problemas no estructurados o si no sabemos siquiera cuál es el problema, no podemos confiar en las máquinas.

La política tiene que ver con cómo gestionamos este tipo de cosas. Las máquinas son malas prediciendo los futuros preferidos, deseables y aspiracionales. La tecnología tiende a extrapolar a partir de datos, pero hay que dejar un gran espacio de indeterminación (recordemos las grandes crisis que hemos sufrido en este siglo -la económica, la pandemia, las guerras…- que nos han pillado por sorpresa). Así que una posible distribución de tareas en la toma de decisiones es la siguiente: una parte de la decisión es política y debe seguir criterios de las personas, y otra parte es mecánica u organizativa y puede delegarse en las máquinas.